Introducción a la máquina de Boltzmann restringida

La máquina de Boltzmann restringida es un método que puede encontrar automáticamente patrones en los datos mediante la reconstrucción de nuestra entrada. Geoff Hinton es el fundador del aprendizaje profundo. RBM es una red superficial de dos capas en la que la primera es visible y la siguiente es la capa oculta. Cada nodo en la capa visible se une a cada nodo en la capa oculta. La máquina de Boltzmann restringida se considera restringida porque dos nodos de la misma capa no forman una conexión. Un RBM es el equivalente numérico de un traductor bidireccional. En el camino hacia adelante, un RBM recibe la entrada y la convierte en un conjunto de números que codifica la entrada. En el camino hacia atrás, toma esto como resultado y procesa este conjunto de entradas y las traduce al revés para formar las entradas retrasadas. Una red súper entrenada podrá realizar esta transición inversa con gran veracidad. En dos pasos, el peso y los valores tienen un papel muy importante. Permiten a RBM decodificar las interrelaciones entre las entradas y también ayudan a RBM a decidir qué valores de entrada son más importantes para detectar las salidas correctas.

Trabajo de la máquina de Boltzmann restringida

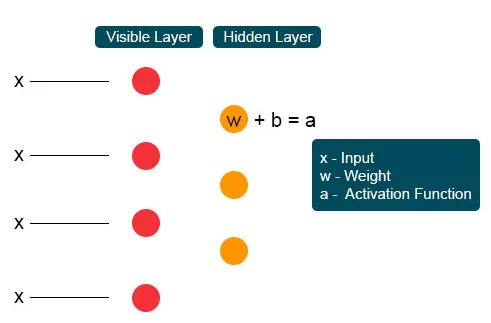

Cada nodo visible recibe un valor de bajo nivel de un nodo en el conjunto de datos. En el primer nodo de la capa invisible, X está formada por un producto de peso y se agrega a un sesgo. El resultado de este proceso se alimenta a la activación que produce la potencia de la señal de entrada dada o la salida del nodo.

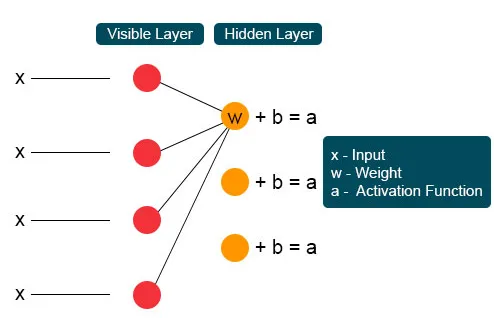

En el siguiente proceso, varias entradas se unirían en un solo nodo oculto. Cada X se combina con el peso individual, la adición del producto se ajusta a los valores y nuevamente el resultado se pasa a través de la activación para proporcionar la salida del nodo. En cada nodo invisible, cada entrada X se combina con el peso individual W. La entrada X tiene tres pesos aquí, haciendo doce juntos. El peso formado entre la capa se convierte en una matriz donde las filas son precisas para los nodos de entrada y las columnas se satisfacen para los nodos de salida.

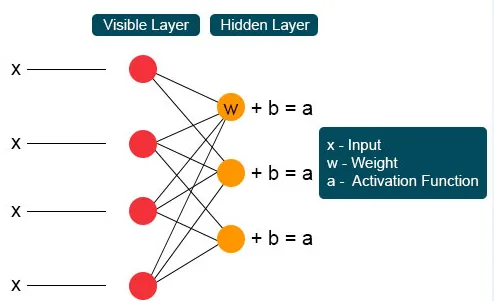

Cada nodo invisible obtiene cuatro respuestas multiplicadas por su peso. La adición de este efecto se agrega nuevamente al valor. Esto actúa como un catalizador para que suceda algún proceso de activación y el resultado se alimenta nuevamente al algoritmo de activación que produce cada salida para cada entrada invisible.

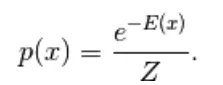

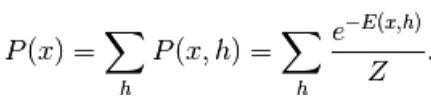

El primer modelo derivado aquí es el modelo basado en energía. Este modelo asocia energía escalar con cada configuración de la variable. Este modelo define la distribución de probabilidad a través de una función de energía de la siguiente manera,

(1)

Aquí Z es el factor de normalización. Es la función de partición en términos de sistemas físicos.

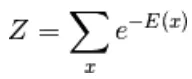

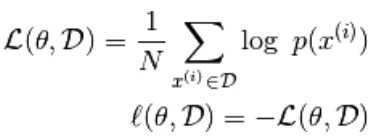

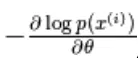

En esta función basada en energía sigue una regresión logística de que el primer paso definirá el registro. probabilidad y la próxima definirá la función de pérdida como una probabilidad negativa.

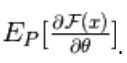

usando el gradiente estocástico,  dónde

dónde  son los parámetros,

son los parámetros,

El modelo basado en energía con una unidad oculta se define como 'h'

La parte observada se denota como 'x'

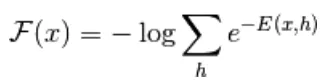

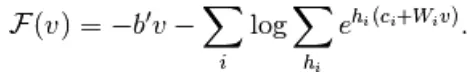

De la ecuación (1), la ecuación de energía libre F (x) se define como sigue

(2)

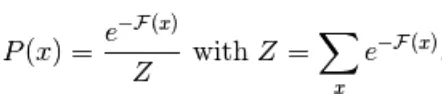

(3)

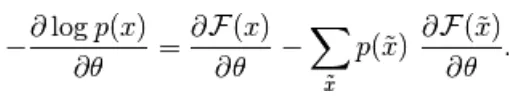

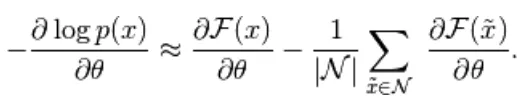

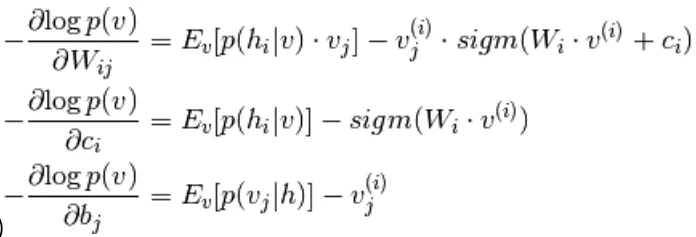

El gradiente negativo tiene la siguiente forma,

(4)

La ecuación anterior tiene dos formas, la forma positiva y la negativa. El término positivo y negativo no está representado por signos de las ecuaciones. Muestran el efecto de la densidad de probabilidad. La primera parte muestra la probabilidad de reducir la energía libre correspondiente. La segunda parte muestra la reducción de la probabilidad de muestras generadas. Entonces el gradiente se determina de la siguiente manera,

(5)

Aquí N es partículas negativas. En este modelo basado en energía, es difícil identificar el gradiente analíticamente, ya que incluye el cálculo de

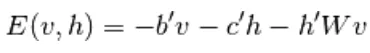

Por lo tanto, en este modelo EBM, tenemos una observación lineal que no puede representar los datos con precisión. Entonces, en el siguiente modelo de máquina de Boltzmann restringida, la capa oculta es más para tener una alta precisión y prevención de pérdida de datos. La función de energía RBM se define como,

(6)

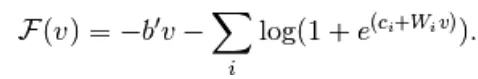

Aquí, W es el peso que conecta las capas visibles y ocultas. b es el desplazamiento de la capa visible. c es el desplazamiento de la capa oculta. convirtiéndose en energía libre,

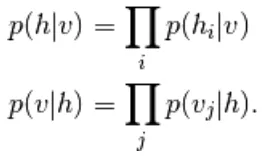

En RBM, las unidades de la capa visible y oculta son completamente independientes y se pueden escribir de la siguiente manera,

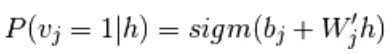

De la ecuación 6 y 2, una versión probabilística de la función de activación neuronal,

(7)

(8)

Se simplifica aún más en

(9)

Combinando la ecuación 5 y 9,

(10)

Muestreo en máquina de Boltzmann restringida

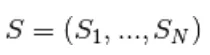

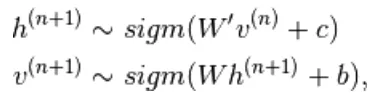

Muestreo de Gibbs de la articulación de N variables aleatorias  se realiza a través de una secuencia de N subpasos de muestreo del formulario

se realiza a través de una secuencia de N subpasos de muestreo del formulario  dónde

dónde

contiene  las otras variables aleatorias en

las otras variables aleatorias en  Excluyendo.

Excluyendo.

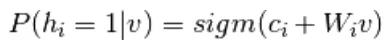

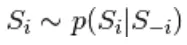

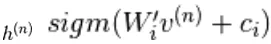

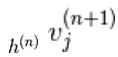

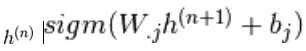

En RBM, S es un conjunto de unidades visibles y ocultas. Las dos partes son independientes y pueden realizar o bloquear el muestreo de Gibbs. Aquí la unidad visible realiza el muestreo y otorga un valor fijo a las unidades ocultas, simultáneamente las unidades ocultas proporcionan valores fijos a la unidad visible mediante el muestreo

aquí,  Es un conjunto de todas las unidades ocultas.

Es un conjunto de todas las unidades ocultas.  Un ejemplo

Un ejemplo  se elige aleatoriamente para ser 1 (versus 0) con probabilidad,

se elige aleatoriamente para ser 1 (versus 0) con probabilidad,  y de manera similar,

y de manera similar,  se elige aleatoriamente para ser 1 (versus 0) con probabilidad

se elige aleatoriamente para ser 1 (versus 0) con probabilidad

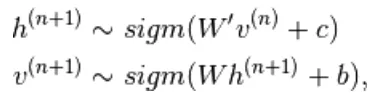

Divergencia contrastante

Se utiliza como catalizador para acelerar el proceso de muestreo.

Como esperamos ser verdad, esperamos  el valor de distribución debe estar cerca de P para que forme una convergencia con la distribución final de P

el valor de distribución debe estar cerca de P para que forme una convergencia con la distribución final de P

Pero la divergencia contrastante no espera a que la cadena converja. La muestra se obtiene solo después del proceso de Gibb, por lo que establecemos aquí k = 1 donde funciona sorprendentemente bien.

Persistente divergencia contrastante

Este es otro método para el formulario de muestreo de aproximación. Es un estado persistente para cada método de muestreo, extrae nuevas muestras simplemente cambiando los parámetros de K.

Capas de máquina de Boltzmann restringida

La máquina de Boltzmann restringida tiene dos capas, redes neuronales poco profundas que se combinan para formar un bloque de redes de creencias profundas. La primera capa es la capa visible y la otra capa es la capa oculta. Cada unidad se refiere a un círculo neuronal llamado nodo. Los nodos de la capa oculta están conectados a los nodos de la capa visible. Pero dos nodos de la misma capa no están conectados. Aquí el término Restringido se refiere a que no hay comunicación intracapa. Cada nodo procesa la entrada y toma la decisión estocástica de transmitir la entrada o no.

Ejemplos

El papel importante de RBM es una distribución de probabilidad. Los idiomas son únicos en sus letras y sonidos. La distribución de probabilidad de la letra puede ser alta o baja. En inglés, las letras T, E y A son ampliamente utilizadas. Pero en islandés, las letras comunes son A y N. no podemos tratar de reconstruir el islandés con un peso basado en el inglés. Conducirá a la divergencia.

El siguiente ejemplo son las imágenes. La distribución de probabilidad de su valor de píxel difiere para cada tipo de imagen. Podemos considerar que hay dos imágenes Elephant y Dog para los nodos de entrada de remolque, el pase directo de RBM generará preguntas como ¿debería generar un nodo de píxeles fuerte para el nodo de elefante o el nodo de perro? Luego, el pase hacia atrás generará preguntas como para elefante, ¿cómo debo esperar una distribución de píxeles? Luego, con la probabilidad conjunta y la activación producida por los nodos, construirán una red con coincidencia conjunta como orejas grandes, tubo gris no lineal, orejas flexibles, la arruga es el elefante. Por lo tanto, RBM es el proceso de aprendizaje profundo y visualización, forman dos sesgos principales y actúan sobre su sentido de activación y reconstrucción.

Ventajas de la máquina de Boltzmann restringida

- La máquina de Boltzmann restringida es un algoritmo aplicado utilizado para la clasificación, regresión, modelado de temas, filtrado colaborativo y aprendizaje de características.

- La máquina de Boltzmann restringida se utiliza para la neuroimagen, la reconstrucción de imágenes dispersas en la planificación de minas y también en el reconocimiento de objetivos de radar

- RBM puede resolver un problema de datos desequilibrados mediante un procedimiento SMOTE

- RBM encuentra valores perdidos mediante el muestreo de Gibb que se aplica para cubrir los valores desconocidos

- RBM supera el problema de las etiquetas ruidosas por datos de etiquetas no corregidos y sus errores de reconstrucción

- El problema de los datos no estructurados se rectifica mediante un extractor de características que transforma los datos sin procesar en unidades ocultas.

Conclusión

El aprendizaje profundo es muy poderoso, que es el arte de resolver problemas complejos, sigue siendo un espacio de mejora y complejo de implementar. Las variables libres deben configurarse con cuidado. Las ideas detrás de la red neuronal eran difíciles antes, pero hoy el aprendizaje profundo es el pie del aprendizaje automático y la inteligencia artificial. Por lo tanto, RBM da una idea de los enormes algoritmos de aprendizaje profundo. Se trata de la unidad básica de composición que creció progresivamente en muchas arquitecturas populares y se usó ampliamente en muchas industrias a gran escala.

Artículo recomendado

Esta ha sido una guía de la máquina restringida de Boltzmann. Aquí discutimos su funcionamiento, muestreo, ventajas y capas de la máquina de Boltzmann restringida. También puede consultar nuestros otros artículos sugeridos para obtener más información _

- Algoritmos de aprendizaje automático

- Arquitectura de aprendizaje automático

- Tipos de aprendizaje automático

- Herramientas de aprendizaje automático

- Implementación de redes neuronales