Diferencia entre TensorFlow y Spark

¿Qué es TensorFlow?

TensorFlow implica una biblioteca de código abierto amigable con Python para el cómputo numérico que realiza el aprendizaje automático más rápido y más directo. TensorFlow permite a los desarrolladores diseñar gráficos de flujo de datos, estructuras que definen cómo se mueven los datos sobre un gráfico, ya sea una serie de nodos de procesamiento. Un nodo individual dentro de un gráfico particular significa alguna operación matemática. Además, todos los puntos, ya sea asociación entre nodos, implica algún tensor multidimensional, preferentemente la recolección de datos. TensorFlow da todo sobre eso para el desarrollador a través del lenguaje popular Python. Este lenguaje es simple de trabajar y fácil de aprender, y ofrece enfoques aceptables para representar mediante el cual las abstracciones de alto nivel se pueden vincular a los tensores, y los nodos colectivamente son objetos de Python en TensorFlow.

Además, las aplicaciones de TensorFlow siguen siendo aplicaciones de Python. En Python, las operaciones matemáticas correctas, sin embargo, no están implementadas. Las modificaciones en las bibliotecas a las que se puede acceder a través de TensorFlow se componen de manera similar a los binarios de C ++ con un rendimiento superior. Python proporciona abstracciones de programación de alto nivel al dirigir directamente el tráfico entre las piezas y asegurarlas juntas. Las aplicaciones de TensorFlow se pueden operar en casi todos los objetivos accesibles: una máquina local, iOS, un clúster en la nube, CPU o GPU y dispositivos Android. Si la nube privada de Google le resulta familiar, para una aceleración adicional, puede ejecutar el silicio de la Unidad de procesamiento de TensorFlow (TPU) personalizado de Google hacia TensorFlow. Y luego, los modelos resultantes desarrollados por TensorFlow, sin embargo, se pueden implementar en la mayoría de los dispositivos donde se manejarán para servir predicciones.

¿Qué es la chispa?

Apache Spark es un sistema de computación en clúster de alta velocidad y uso general. Ofrece API de alto nivel en Scala, Python, Java y R, y un motor optimizado que promueve gráficos de ejecución generales. También ayuda a un amplio conjunto de herramientas de alto nivel que incluyen MLlib para aprendizaje automático, GraphX para procesamiento de gráficos y Spark SQL para SQL y procesamiento de datos estructurados, Spark Streaming. Apache Spark tiene como base estructural el conjunto de datos distribuidos (RDD) resistente, un conjunto múltiple de elementos de datos de solo lectura dispersos en un grupo de máquinas, que se mantiene de forma tolerante a fallas. En Spark 1.x, el RDD hizo la interfaz de programación de aplicaciones (API) inicial, sin embargo, a partir de la utilidad Spark 2.x del conjunto de datos, API admitida a pesar de que esta API RDD no está en desuso. La tecnología RDD aún posee la API Dataset. Spark también sus RDD se formaron en 2012 en respuesta a restricciones en el estándar de computación en clúster MapReduce, lo que obliga a una estructura de flujo de datos lineal apropiada en programas compartidos: los programas MapReduce escanean datos de entrada del disco, mapean una función sobre los datos, disminuyen los resultados de mapa, además almacena resultados de reducción hacia el disco.

Los RDD de Spark funcionan un conjunto de trabajo esencialmente para programas distribuidos que contribuyen con una forma limitada (intencionalmente) de memoria compartida asignada. Spark promueve la implementación de ambos algoritmos iterativos, que visitan su conjunto de datos varias veces dentro de un ciclo, y el análisis de datos interactivo / exploratorio, es decir, la consulta de datos replicada al estilo de la base de datos. La latencia de tales aplicaciones puede verse reducida en muchos órdenes de magnitud asociados con una implementación de MapReduce (como era popular en las pilas de Apache Hadoop). Con la clase de algoritmos iterativos se encuentran los algoritmos básicos para los sistemas de aprendizaje automático, que crearon el ímpetu principal para desarrollar Apache Spark.

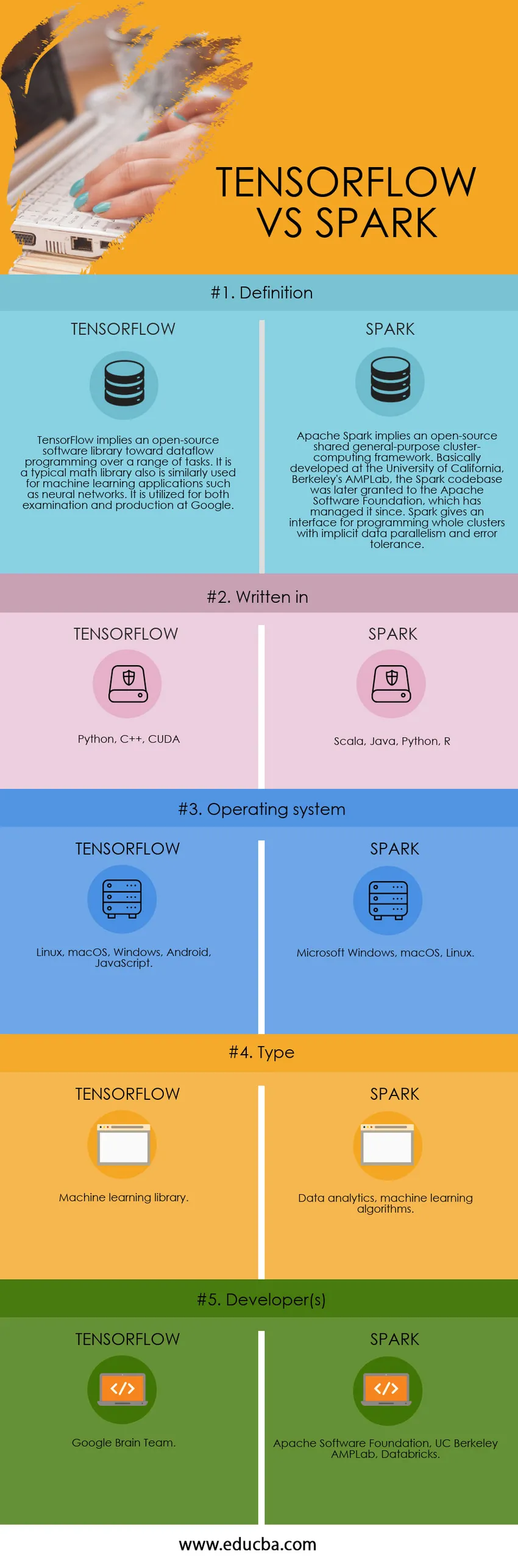

Comparación cabeza a cabeza entre TensorFlow y Spark (infografía)

A continuación se muestran las 5 principales diferencias entre TensorFlow y Spark

Diferencias clave entre TensorFlow y Spark

Tanto TensorFlow vs Spark son opciones populares en el mercado; discutamos algunas de las principales diferencias entre TensorFlow y Spark

- Apache Spark preferentemente Spark, ya que se lo conoce comúnmente como un marco de cómputo de clúster de código abierto que brinda una interfaz para grupos de programación completos con paralelismo de datos implícito y también tolerancia a fallas. TensorFlow, por otro lado, es una biblioteca compacta desarrollada por Google que ayuda para mejorar el rendimiento del cómputo numérico, incluso las redes neuronales, y generar flujo de datos como gráficos, que consisten en nodos que indican operaciones y bordes que representan una matriz de datos.

- Spark, esencialmente un gran marco de datos, ha hecho posible que un gran número de corporaciones que generan una gran cantidad de datos de usuarios puedan procesarlo de manera eficiente y, además, ofrecer recomendaciones a escala. Mientras que Tensorflow, esencialmente un marco de aprendizaje automático, ayuda a las personas a crear modelos de aprendizaje extensivos sin la necesidad de un conjunto riguroso de habilidades de un especialista en aprendizaje automático.

- En Spark, un motor rápido e integral para el procesamiento de datos a gran escala permite diversas funciones como transmisión y análisis sofisticados, alta velocidad, facilidad de uso, puede conectarse con SQL, puede ejecutarse en cualquier lugar, como Mesos, Hadoop y la nube. Por otro lado, en Tensorflow, una API de Google que permite el cálculo de un gran aprendizaje y aprendizaje automático, TensorFlow ofrece un flujo de cálculo de representación gráfica. La API alienta al usuario a escribir un diseño complejo de red neuronal y también lo ajusta de acuerdo con los valores de activación.

- Tensorflow escrito en Python, C ++, CUDA.En contraste, Spark está escrito en Scala, Java, Python, R

- TensorFlow On Spark resuelve la dificultad de desplegar un alto aprendizaje en grupos de datos significativos de manera distribuida, lo cual no es un paradigma de conocimiento robusto completamente moderno, sin embargo, preferiblemente una actualización a los marcos actuales que necesitaban el desarrollo de varios programas para expandir la inteligencia en grupos de datos significativos. Al conectar tanto TensorFlow como Spark, proporciona un alcance a la complejidad del sistema no deseada, así como a la latencia de aprendizaje de extremo a extremo.

Tabla de comparación de TensorFlow vs Spark

A continuación se muestra la 5 comparación más importante entre TensorFlow vs Spark

| La base de comparación entre TensorFlow vs Spark |

FLUJO TENSOR |

CHISPA - CHISPEAR |

| Definición | TensorFlow implica una biblioteca de software de código abierto para la programación del flujo de datos en una variedad de tareas. Es una biblioteca matemática típica que también se usa de manera similar para aplicaciones de aprendizaje automático, como redes neuronales. Se utiliza tanto para el examen como para la producción en Google. | Apache Spark implica un marco de cómputo de clúster de uso general compartido de código abierto. Básicamente desarrollado en la Universidad de California, AMPLab de Berkeley, la base de código Spark se otorgó más tarde a la Apache Software Foundation, que lo ha administrado desde entonces. Spark ofrece una interfaz para programar grupos completos con paralelismo de datos implícito y tolerancia a errores. |

| Escrito en | Python, C ++, CUDA | Scala, Java, Python, R |

| Sistema operativo | Linux, macOS, Windows, Android, JavaScript | Microsoft Windows, macOS, Linux |

| Tipo | Biblioteca de aprendizaje automático | Análisis de datos, algoritmos de aprendizaje automático |

| Desarrollador (es) | Google Brain Team | Apache Software Foundation, UC Berkeley AMPLab, Databricks |

Conclusión

En resumen, Apache Spark implica un marco de procesamiento de datos, mientras que TensorFlow se utiliza para un gran aprendizaje personalizado y diseño de redes neuronales. Por lo tanto, si un usuario requiere implementar algoritmos de aprendizaje profundo, TensorFlow es la solución, y para el procesamiento de datos, es Spark.

Artículos recomendados

Esta ha sido una guía de la principal diferencia entre TensorFlow y Spark. Aquí también discutimos las diferencias clave de TensorFlow vs Spark con la infografía y la tabla de comparación. También puede echar un vistazo a los siguientes artículos para obtener más información.

- Tensorflow vs Pytorch

- Splunk vs Spark

- SOAP vs WSDL

- Hadoop vs Spark

- Los 7 mejores métodos arquitectónicos para el aprendizaje profundo